Polarisatie? Het échte probleem is niet de filterbubbel, maar de echokamer

Steeds meer mensen verkrijgen hun nieuws online via een handvol socialmediaplatforms en zoekmachines. Experts waarschuwen er daarom al jaren voor dat mensen hierdoor nauwelijks nog informatie te zien krijgen die hun eigen standpunten tegenspreekt. Met als gevolg dat mensen alsmaar verder geïsoleerd raken in hun eigen ‘bubbel’.

De vraag is echter of deze redenatie helemaal klopt. In mijn boek ‘Alive and Clicking – Er is hoop voor de democratie’ (affiliate) ging ik op onderzoek uit.

Het verhaal van de filterbubbel

Voor het verhaal van de filterbubbel moeten we op het moment van schrijven ruim veertien jaar terug in de tijd. Het is februari 2011. De Amerikaanse auteur, activist en ondernemer Eli Pariser stapt in Long Beach Californië op de bekende rode stip. Hij opent zijn TED-talk met een quote van Mark Zuckerberg:

A squirrel dying in your front yard may be more relevant to your interests right now than people dying in Africa.

Los van het feit dat hij hier (schrikbarend genoeg) weleens gelijk in zou kunnen hebben, is het volgens Pariser veel zorgwekkender dat socialmediaplatforms en zoekmachines bewust worden ontworpen op basis van deze gedachte. Voor Pariser, die ver van de grote stad opgroeide, betekende het internet iets heel anders. Het betekende voor hem een verbinding met de wereld en hij was ervan overtuigd dat het een goede ontwikkeling zou zijn voor de democratie. Hij zocht vaak doelbewust naar de meningen en opvattingen van andersdenkenden.

Maar beetje bij beetje verdwenen deze andersdenkenden uit zijn tijdlijn. Het algoritme van Facebook leerde namelijk dat hij uiteindelijk vooral op de links klikte van mensen met vergelijkbare opvattingen. Het algoritme besloot daarom, gedreven door de optimalisatiedoelen om mensen zo lang mogelijk op het platform te houden, om de andere content niet langer te laten zien. Zonder overleg of uitleg.

Volgens Pariser heeft niet alleen Facebook dit probleem, maar ook zoekmachines zoals Google. Zo zou de zoekgigant gebruik maken van 57 kenmerken om zoekopdrachten te personaliseren. Welke computer je gebruikt, waar je bent en natuurlijk je voorgaande zoekopdrachten en klikgedrag zijn allemaal bepalend voor de content die je krijgt voorgeschoteld.

Als proef op de som vroeg hij vrienden om afzonderlijk van elkaar het woord ‘Egypte’ te Googelen. Terwijl de een voornamelijk berichten te zien kreeg over de protesten die destijds in Egypte plaatsvonden, kreeg de ander vooral reisinformatie te zien over Egypte als vakantiebestemming. Dit zorgt er volgens hem voor dat we in een wereld zijn terechtgekomen waarin het internet ons laat zien wat het denkt dat we willen zien, maar niet noodzakelijkerwijs wat we zouden moeten zien voor een evenwichtig beeld.

Je eigen persoonlijke, unieke universum van informatie

Wanneer je al de verschillende filters samenneemt, krijg je wat Pariser een ‘filterbubbel’ noemt. Een filterbubbel is je eigen persoonlijke, unieke universum van informatie waarin je online leeft. Het probleem is niet alleen dat je hierdoor steeds verder geïsoleerd raakt, maar ook dat je geen controle meer hebt over wat er binnenkomt. Je hebt daarbij geen zicht op wat er wel en niet uitgefilterd wordt.

Hij vergelijkt het met een dieet. Een goed dieet is gevarieerd en gebalanceerd. Het is niet zo dat je helemaal nooit een snack of een dessert mag nemen, maar het is dan wel belangrijk dat je voldoende vitamines en mineralen binnenkrijgt.

Hetzelfde geldt volgens hem voor de consumptie van informatie. Een ‘informatiesnack’ is op zijn tijd natuurlijk helemaal niet ongezond. Maar er moet dan wel voldoende gevarieerde en betrouwbare informatie binnenkomen. Algoritmen leren echter vooral van wat we het éérst aanklikken. En aangezien we voornamelijk gericht zijn op de korte termijn, zullen we eerder geneigd zijn om voor de snack te gaan. Deze filters zorgen er dus voor dat ons informatiedieet uit balans raakt en we vooral informatie junkfood te zien krijgen.

Ook ongemakkelijke, uitdagende en belangrijke informatie

Om uit deze situatie te komen hebben we volgens Pariser algoritmen nodig die transparant zijn, zodat we kunnen zien op basis van welke regels er is bepaald welke informatie we te zien krijgen en wat eruit is gefilterd. Op deze wijze heeft de gebruiker meer controle over wat er binnenkomt of uitgelaten wordt. Kortom, we moeten er volgens Pariser voor gaan zorgen dat we niet alleen de meest relevante content te zien krijgen, die aansluit op onze profielen, maar ook informatie die ongemakkelijk, uitdagend en belangrijk is. Want alleen als we kennis maken met nieuwe ideeën en nieuwe mensen kunnen we uit onze bubbel komen.

Een staande ovatie en een ietwat ongemakkelijk ogende Pariser volgden. De talk is inmiddels meer dan 6 miljoen keer bekeken en er wordt ook nu nog vaak naar verwezen. Bijvoorbeeld om de herverkiezing van Trump te duiden. En hoewel hij wel degelijk onze ogen heeft geopend (we stonden voor die tijd immers veel minder stil bij het effect van algoritmisch gecureerde informatie) blijft het de vraag in hoeverre we online daadwerkelijk in een afgesloten bubbel zitten. Tijd om te bekijken wat wetenschappelijk onderzoek hierover heeft te zeggen.

Hoe de bubbel barstte

Het blijkt in de praktijk helemaal niet zo eenvoudig te zijn om in een bubbel te blijven. Volgens onderzoekers van Oxford University draagt de aard van social media er juist aan bij dat mensen worden blootgesteld aan een grote diversiteit aan bronnen. Inderdaad, via social media worden gebruikers vaker blootgesteld aan gepolariseerde content. Maar in tegenstelling tot het concept van de filterbubbel, blijkt uit het onderzoek dat deze gebruikers ook vaker sites bezoeken die tegengestelde standpunten aanbieden. Hun mediadieet is over het algemeen dus juist gevarieerder.

Ook andere onderzoekers komen tot een vergelijkbare conclusie. Mensen die bovengemiddeld veel gepolariseerde informatie consumeren, blijken ook bovengemiddeld veel mainstream nieuws tot zich te nemen. Het is dus niet zo dat mensen alleen in de krochten van het internet blijven hangen. Ook al verplaatst nieuws zich in toenemende mate naar online, het zijn nog steeds vooral de mainstream nieuwsaanbieders die de meeste mensen aantrekken.

Social media en zoekmachines stellen je bloot aan gevarieerde bronnen

Zo is in het Verenigd Koninkrijk BBC News online verreweg de meest geraadpleegde website om nieuws te consumeren. Een vergelijkbare trend zien we in de Verenigde Staten, waar CNN.com bovenaan het lijstje staat. Ook zoekmachines hebben een positieve bijdrage aan deze diversiteit. Uit onderzoek blijkt dat algoritmische curatie juist tot een vorm van serendipiteit leidt. Mensen die zoekmachines inzetten tijdens hun zoektocht naar nieuws, raadplegen gemiddeld genomen meer nieuwsbronnen dan mensen die dat niet doen. En misschien nog wel belangrijker, ze raadplegen vaker bronnen aan weerszijden van het politieke spectrum. Juist mensen die direct naar een nieuwsbron gaan, blijken minder vaak uit hun bubbel te stappen. Hetzelfde geldt voor mensen die hun nieuws vooral offline consumeren. Zij keren steeds terug bij dezelfde kranten en zenders. Social media en zoekmachines stellen je van nature bloot aan gevarieerde bronnen, wat de diversiteit van nieuwsconsumptie stimuleert.

Toch mogen we niet te vroeg juichen. Er zijn namelijk argumenten die de filterbubbel weliswaar ontkrachten, maar alsnog slecht nieuws zijn. Je zou verwachten dat mensen die voornamelijk eenzijdige content voorgeschoteld krijgen meer gepolariseerd raken. En in lijn met deze redenatie zou je dus ook verwachten dat mensen die een meer gevarieerd nieuwsdieet volgen, juist minder gepolariseerd raken.

Nog meer polarisatie

Toch lijkt het tegenovergestelde waar te zijn. Zo blijkt uit onderzoek van Duke University dat Amerikanen die geconfronteerd worden met nieuwsberichten ‘uit het andere kamp’ meer gepolariseerd raken. Onderzoekers rekruteerden honderden Democraten en Republikeinen die actief zijn op Twitter (nu X) en betaalden hen om een Twitter-bot te volgen die inhoud van de andere partij zou retweeten. Na een maand van blootstelling bleken de deelnemers nóg overtuigder te zijn van hun eigen opvattingen. Met name de Republikeinen bleken gevoelig voor dit experiment. Niet omdat ze door de filterbubbel geen afwijkende meningen meer te zien kregen, maar juist doordat ze in aanraking kwamen met tegenstrijdige opvattingen.

Dit is vanuit onze menselijke natuur geredeneerd niet eens zo vreemd. We vinden het nu eenmaal niet prettig om geconfronteerd te worden met tegenstrijdige opvattingen. Dit onaangename gevoel wordt in de psychologie ook wel ‘cognitieve dissonantie’ genoemd. Mensen zijn daardoor geneigd om informatie te negeren die niet overeenkomt met hun opvattingen. Of om deze zodanig te verdraaien dat het wel past. Hierdoor ontstaan hardnekkige mispercepties.

Zo schatten veel mensen het percentage van de bevolking dat is geboren in een ander land veel te hoog in. Wanneer ze vervolgens worden geconfronteerd met corrigerende informatie, blijken ze hun mispercepties niet aan te passen.

Sterker nog, deze corrigerende informatie zorgt zelfs voor een versterking van deze misperceptie. Hoe vaker we geconfronteerd worden met tegenstrijdige informatie, hoe sterker we in onze eigen opvattingen gaan geloven. Dit wordt ondersteund door onderzoek van het Massachusetts Institute of Technology (MIT). Wanneer mensen op Twitter door een andere gebruiker worden gecorrigeerd voor het plaatsen van misleidende informatie, dan heeft dit een negatief effect op de berichten die ze later zullen delen. Deze blijken dan een nog lagere kwaliteit te hebben en nog meer toxisch en polariserend te zijn. En dit is weer koren op de molen voor platformbedrijven zoals Facebook. ‘Boze mensen’ blijven nu eenmaal langer op het platform.

Ook buiten de filterbubbel kijken

Als we de polariserende werking van het internet goed willen begrijpen moeten we dus ook buiten de filterbubbel kijken. Het is bijvoorbeeld niet zo dat mensen die geloven dat de aarde plat is (de ‘flat-Earthers’), nog nooit hebben gehoord dat de aarde ook een andere vorm zou kunnen hebben. Ze zijn zich er ongetwijfeld van bewust dat de aarde volgens de algemeen geaccepteerde opvatting rond is. Sterker nog, ze zetten zich er openlijk tegen af.

Wanneer wetenschappers online artikelen of video’s delen over de ruimte, zijn het juist de meest fanatieke aanhangers die de tegenaanval inzitten en hun verontwaardiging uiten in de comments. Vaak in hoofdletters en met het gebruik van veel leestekens. De confrontatie met radicaal andersdenkenden zorgt juist voor fanatisme. Naast het ontwerp (en het verdienmodel) van social mediaplatforms en zoekmachines moeten er daarom ook andere, meer sociale constructen zijn die de oplopende emoties verklaren.

De galm van de echokamer

In zijn boek ‘Why We’re Polarized’ beschrijft Ezra Klein dat Amerika ook voor de komst van Facebook en Google gepolariseerd was. Technologie is volgens hem hooguit een versneller geweest, in plaats van een oorspronkelijke oorzaak. In plaats van onze menselijk natuur te veranderen, speelt technologie er juist op in en vergroot deze uit. Met de komst van social media werden mensen volgens Klein geconfronteerd met een nieuwe vorm van publieke druk. Namelijk de druk om een consistente identiteit te hebben.

Door socialmediaplatforms werden we plots een persona. We kregen een profiel met een enorm bereik én een traceerbare geschiedenis. Om in deze nieuwe parallelle wereld consistent te kunnen zijn, moesten we op zoek naar aanwijzingen over wat in onze omgeving doorging voor consistent. Er zat niets anders op dan naar andere leden van onze gemeenschap te kijken. Door de overkoepelende virtuele profielen werden onze verschillende identiteiten die we offline hadden, als het ware op elkaar gestapeld. En dat allemaal onder de noemer van ‘politieke voorkeur’.

Een plek waar we bevestigd worden in onze eigen overtuigingen

Onze voorkeuren worden volgens Klein steeds meer ondergebracht onder een ‘mega-identiteit’ die ons een vaste plek heeft gegeven op het politieke spectrum. Links of rechts. Progressief of conservatief. Als we geconfronteerd worden met andersdenkenden duiken we snel terug in onze eigen veilige community, om zo onze frustraties te kunnen delen met gelijkgestemden. Deze communities worden niet afgesloten door een bubbel, maar fungeren als een zogenaamde ‘echokamer’. Een plek waar we bevestigd worden in onze eigen overtuigingen en waar andersdenkenden gedemoniseerd worden. Het is volgens Klein heel moeilijk om mensen een sterk gevoel te geven van ‘wie we zijn’ zonder te definiëren ‘wie we niet zijn’.

Ondanks de open structuur van een echokamer, ontstaan er toch ‘gesloten’ netwerken. In deze netwerken worden vooral de eigen opvattingen geprezen en wordt de draak gestoken met mensen die er een andere opvatting op na houden. Opvattingen echoën rond door de ‘kamer’, waardoor het lijkt alsof de eigen groep enorm omvangrijk en vocaal is. Maar in werkelijkheid zijn het zeer geconcentreerde groepen, die qua omvang slechts een fractie vormen van de gehele populatie.

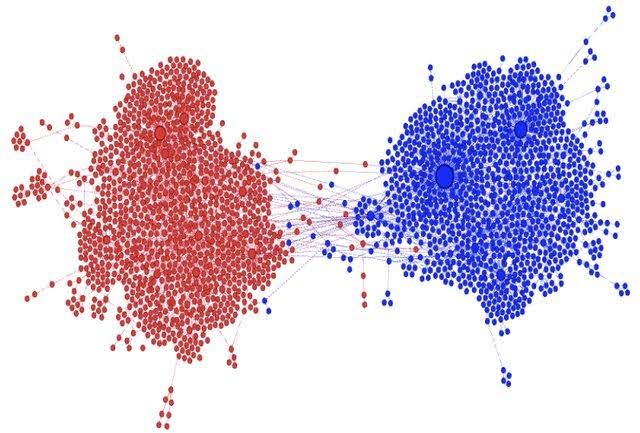

Onderzoekers brachten het ‘echokamereffect’ op Twitter in kaart en keken naar het retweet-gedrag van gebruikers omtrent de controversiële #beefban discussie in 2015. Toen werd aangekondigd dat het eten van rundvlees in de Indiase staat Maharashtra bij wet zou worden verboden, liepen de emoties op Twitter hoog op. Al snel ontstonden er twee kampen: voor- en tegenstanders van het verbod.

Menselijke keuzes

Zoals de visual laat zien, is er qua retweets nauwelijks sprake van ‘kruisbestuiving’ tussen de twee kampen. Voorstanders deelden vooral berichten van andere voorstanders. Net zoals tegenstanders vooral berichten deelden van andere tegenstanders. De verdeling die hierdoor ontstond is niet het werk van een polariserend algoritme, maar het gevolg van menselijke keuzes.

Bron: Kumar, S. & Shah, N. (2018).

Het probleem van een echokamer is dus niet dat mensen niet meer in aanraking kúnnen komen met andersdenkenden, maar dat andersdenkenden niet langer worden vertrouwd. Tegelijkertijd kan het vertrouwen in gelijkgestemden juist in alle vrijheid groeien. In dat opzicht heeft een echokamer wel wat weg van een sekte.

Echokamers als redding

Echokamers isoleren hun leden niet door hun communicatielijnen met de buitenwereld af te snijden, maar door te beïnvloeden wie en wat ze vertrouwen. Met name in tijden van grote onzekerheid, waarin mensen het gevoel hebben dat ze de controle verliezen, komt een narratief dat hun gevoelens verklaart en een veilige gemeenschap biedt als een enorme redding.

Onderdeel van het narratief is vaak een gemeenschappelijke vijand die de veroorzaker is van alle problemen, zoals de overheid of de media. Crises zijn dan ook een voedingsbodem voor complottheorieën. Denk bijvoorbeeld aan de opleving van de QAnon beweging tijdens de coronapandemie.

Een weg voorwaarts

Als we het polariserende ontwerp van het internet willen aanpakken, moeten we dus niet alleen naar de algoritmes kijken, maar ook naar het menselijk gedrag. Een kijkje in ons brein kan hierbij helpen. Een studie over politieke polarisatie toont aan dat politiek gepolariseerde hersenen een intolerantie voor onzekerheid delen.

Wetenschappers van Brown University gebruikten fMRI-technologie om de hersenactiviteit van toegewijde liberalen en conservatieven te meten, terwijl ze naar politieke debatten en nieuwsuitzendingen keken. De onderzoekers ontdekten dat een gepolariseerde perceptie het sterkst is bij mensen die over het algemeen de laagste tolerantie voor onzekerheid hebben. Dit toont aan dat een deel van de vijandigheid en het onbegrip dat we in de samenleving zien, niet te wijten is aan onverenigbare verschillen in politieke overtuigingen, maar wordt veroorzaakt door de onzekerheden die mensen in het dagelijks leven ervaren. Onzekerheden die mogelijk oplosbaar zijn.

Tussen de extremen ligt geen gapend gat

Onderzoekers zagen dan ook geen effect van gepolariseerde perceptie bij video’s die op een neutrale, onpartijdige manier werden gepresenteerd. Dit betekent dat de breinen van liberale en conservatieve burgers niet fundamenteel van elkaar verschillen, zoals eerder werd beweerd. In plaats daarvan ontstaan ideologische verschillen in de hersenen door blootstelling aan specifieke, polariserende content. Dat betekent dat politieke tegenpolen elkaar wél kunnen begrijpen, als we maar de juiste manier vinden om met elkaar te communiceren. Tussen de extremen ligt geen gapend gat, maar een ruimte waar (vaak onopgemerkt) enorm veel consensus is.

Ironisch genoeg kan technologie ons helpen bij het vinden van consensus. Nieuwsgierig hoe dat werkt? Lees dan mijn eerdere artikel voor Frankwatching: Als technologie ons polariseert, kan het ons ook verbinden.

The greatest enemy of knowledge is not ignorance, it is the illusion of knowledge. – Stephen Hawking (1942 – 2018)